Claude Skills、MCP 与通用 LLM 工具插件对比指南 转载

原文:https://skywork.ai/blog/ai-agent/claude-skills-vs-mcp-vs-llm-tools-comparison-2025/

截至 2025 年 10 月,团队扩展大语言模型(LLM)能力的方式主要有三种:Claude Skills、模型上下文协议(MCP) 和 平台专属工具/插件(如 OpenAI 函数调用、Actions/Apps、Gemini Extensions 等)。这三者虽有重叠,但并非彼此替代。本文将详细说明它们的区别、生产环境中的关键权衡,并为开发者、IT 团队和高级用户提供实用的选型路径。

快速定义(明确边界)

- Claude Skills:模块化、可复用的“任务包”,用于教会 Claude 执行可重复的工作流。一个 Skill 是一个文件夹,包含一个 Markdown 文件(含 YAML 前置元数据 + 指令)以及可选的脚本/资源文件;Claude 会扫描元数据,并按需加载相关 Skills(节省上下文 token)。参见 Anthropic 2025 年 10 月发布的公告:Claude Skills 概览 和 Agent Skills 技术深潜。

- 模型上下文协议(MCP):一种开放的客户端–服务器协议,标准化了 AI 应用/智能体如何通过 stdio、HTTP+SSE 等传输方式连接工具、资源和提示模板。核心对象包括:Tools(类型化操作)、Resources(数据后端)、Prompts(模板)。详见官方规范:MCP 规范 — 架构(2025-03-26)。

- 通用 LLM 工具/插件:厂商专属的扩展机制,允许模型在单一平台内调用函数或外部服务(例如 OpenAI 函数调用、Apps/Agents SDK;Google Vertex AI 函数调用和 Gemini Extensions)。参见:OpenAI — 函数调用指南 和 Google Cloud — Vertex AI 访问控制。

如需深入了解协议层与服务器架构,请参阅内部说明文档:《MCP 服务器:AI 工程师必备指南》。

横向对比

| 维度 | Claude Skills | 模型上下文协议(MCP) | 通用 LLM 工具/插件 |

|---|---|---|---|

| 主要用途 | 面向 Claude 的任务型能力包;可重复工作流 | 开放协议,用于向 AI 主机暴露工具/资源/提示 | 平台专属扩展(函数调用、Actions/Apps、Extensions) |

| 抽象层级 | 指令 + 可选脚本/模板 | 协议/接口标准 | 各平台 API/SDK 构造 |

| 配置主体 | 高级用户;开发者(用于脚本化 Skills) | 开发者/DevOps(需编写、托管、认证 MCP 服务器) | 开发者或市场管理员 |

| 治理机制 | 按用户/组织管理 Skill 库;依赖 Claude 的权限与代码执行设置 | 通过 MCP 服务器集中治理(认证、白名单、审计) | 各平台 RBAC 与组织策略 |

| 可移植性 | 仅限 Claude,但可在 Claude 各端通用 | 最高(多主机兼容,开放标准) | 最低(厂商锁定) |

| 依赖项 | 部分任务可离线;外部 API 为可选项 | 需要 MCP 服务器(本地或远程) | 依赖平台运行时 + 外部 API |

| 延迟/成本 | 元数据扫描节省 token;脚本可本地执行 | 远程服务器需 HTTP 跳转(本地 stdio 无额外延迟);需承担托管成本 | 每次调用产生 API 往返;模型 + 外部 API 成本 |

| 适用场景 | 可重复的个人/团队工作流、内容运营 | 企业级集成;多主机复用;强治理需求 | 在单一平台内快速实现功能 |

| 2025 年 10 月可用性 | 已在所有 Claude 端上线;具体套餐细节未完全公开;媒体报道强调付费层 | 开放标准;客户端/服务器生态持续扩展 | 各平台已成熟;细节因厂商而异 |

深度解析:优势、局限与适用场景

Claude Skills

形式与运行机制

一个包含 Markdown 文件(含 YAML 前置元数据和指令)及可选脚本/资源的文件夹。Claude 通过元数据自动判断相关性,仅加载所需内容,从而保持上下文 token 精简。来源:Anthropic — Claude Skills 概览;Anthropic Engineering — Agent Skills 技术深潜。优势

- 通过渐进式加载实现 token 高效利用。

- 非常适合结构化、可重复的任务(如文档/报告生成、风格检查、表格转换)。

- 可利用 Claude 原生的代码执行与文件创建能力(在允许范围内),部分工作流无需外部依赖。详见 Anthropic — Create files 功能公告(2024)。

局限

- 仅限 Claude 使用,无法移植到其他模型主机。

- 治理依赖组织对 Skill 库的审核与分发;执行不可信 Skill 存在风险(Anthropic 工程团队在 2025 年 10 月已明确警示)。

- 某些 Skill 需要代码执行权限,而并非所有组织默认开启。

适用人群

- 希望在不搭建基础设施的前提下,加速个人或部门工作流的高级用户和团队。

- 需要标准化检查清单与模板的内容与运营团队。

可用性与套餐(截至 2025 年 10 月)

Anthropic 表示 Skills 已覆盖所有 Claude 端(Claude.ai、API、Code)。但官网未明确说明免费与付费套餐的差异;媒体报道普遍强调其面向付费用户。参见《The Register》2025 年 10 月 16 日报道:Anthropic ‘Mad Skills’ 报道。

模型上下文协议(MCP)

架构与接口

一种开放协议,允许 AI 主机通过 JSON-RPC 发现并调用服务器暴露的 Tools(类型化函数)、获取 Resources(数据)以及使用 Prompts(模板),支持 stdio(本地)和 HTTP+SSE(远程)等传输方式。权威来源:MCP 规范 — 架构(2025-03-26)。优势

- 厂商中立的集成框架,同一 MCP 服务器可被多个客户端/主机复用。

- 支持集中治理:凭证隔离、白名单控制、可审计的访问路径(Red Hat 在 2025 年总结了相关安全模式,见 Red Hat — MCP 安全风险与控制)。

- 支持本地 stdio 服务器,实现低延迟、离线友好的开发体验;远程服务器则便于共享访问。

局限

- 需要开发资源编写和运维服务器;需自行设计认证与授权机制。

- 远程服务器引入额外网络跳转(延迟);监控与服务等级目标(SLO)需自行负责。

适用人群

- 需要标准化、可审计地访问内部系统与 SaaS 的平台团队和企业。

- 希望构建可在多个主机(桌面、IDE、聊天助手)运行的智能体应用,避免重复实现集成的开发者。

可用性与生态(截至 2025 年)

规范与参考文档已稳定,并在 2025 年持续演进;客户端与服务器生态正在快速扩展。Anthropic 2024 年的公告是很好的入门材料:Anthropic — 引入 MCP。

通用 LLM 工具/插件(平台机制)

平台构造

各平台专属的模型扩展方式,例如:OpenAI 函数调用与 Apps/Agents SDK;Google Vertex AI 函数调用与 Gemini Extensions。参见:OpenAI — 函数调用指南;Google Cloud — Vertex AI 访问控制。优势

- 在单一厂商产品内快速添加功能的最快方式。

- 成熟生态提供强大的管理员/市场工作流,适合快速原型或封闭团队。

局限

- 可移植性差;跨厂商需重新实现。

- 治理与审计能力因平台而异;缺乏跨平台标准化。

适用人群

- 已全面采用某厂商技术栈、希望快速扩展能力的团队。

- 进行限时实验或原型验证的产品与开发团队。

如需动手实践,可参考 IDE 集成入门教程:《Claude Code 插件入门:安装与配置》。

安全与治理:责任归属

Skills

将 Skills 视为需信任的代码与内容。建议组织建立审核机制的 Skill 库;对脚本执行强制审查;在必要时限制代码/计算机使用权限。Anthropic 工程团队在 2025 年 10 月强调:需警惕不可信 Skills,并重视权限控制与用户确认。MCP

利用 MCP 服务器隔离密钥,实施最小权限策略;优先使用标准认证流程并保留审计日志。Red Hat 2025 年分析总结了常见控制措施(认证/授权、白名单、密钥管理),详见 Red Hat — MCP 安全风险与控制。规范中的工具定义也明确了接口契约:MCP 规范 — 服务器工具(2025-06-18)。平台工具/插件

利用厂商提供的 RBAC、审计日志和网络隔离功能。例如 Google 生态中,IAM、Cloud Audit Logs、VPC Service Controls 和 CMEK 均有文档支持(见 Vertex AI 访问控制)。对于敏感的桌面操作,Google 模型还引入了分步确认机制,详见 Google DeepMind — Gemini 计算机使用模型(2024)。

如需了解 MCP 服务器、凭证管理及跨厂商使用的入门知识,请参阅:《什么是 MCP 服务器?》(含 mcp-openai 示例说明)。

性能、延迟与成本

Skills

上下文使用高效(仅加载相关 Skills)。若 Skill 通过本地脚本或 Claude 的代码/计算机使用功能处理文件,网络开销极小;成本主要来自模型 token 和可能调用的外部 API。MCP

本地 stdio 服务器可实现近乎零网络延迟,非常适合开发者工作流。远程服务器增加一次网络跳转;需规划重试/退避机制,并预算托管与可观测性成本。平台工具/插件

每次工具调用均产生一次 API 往返,外加下游 API 成本。性能取决于模型套餐、平台特性(如并行工具调用)及外部服务 SLA。

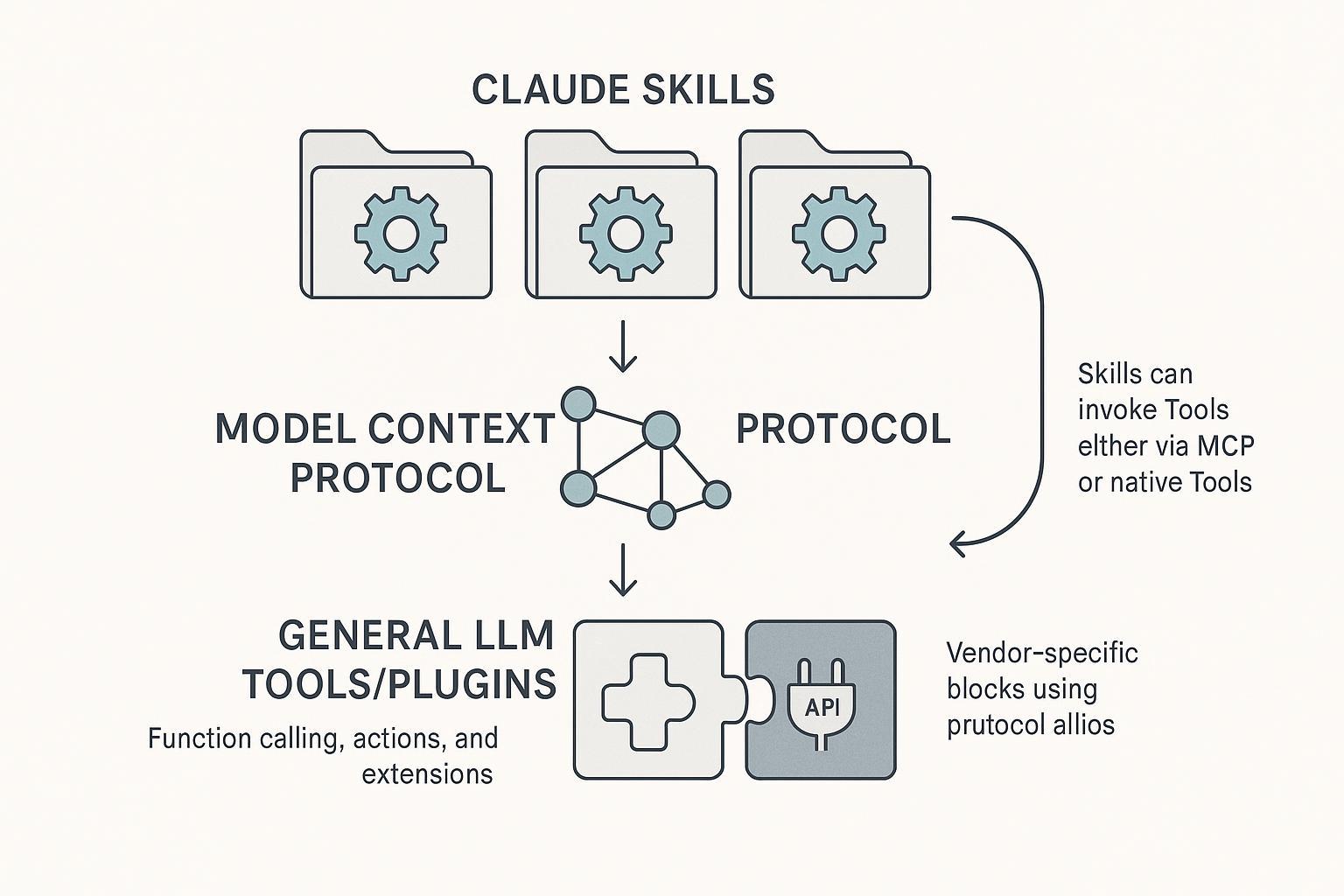

三者关系(可组合使用)

- Claude Skill 可以指示 Claude 调用通过 MCP 或平台原生工具暴露的功能。Skill 是任务抽象层,MCP(或平台工具)是集成机制。

- MCP 旨在减少跨主机的重复实现:同一服务器可被 Claude Desktop、IDE 插件或其他支持 MCP 的客户端复用(OpenAI Agents SDK 已文档化对 MCP 的支持,见 OpenAI — Agents SDK MCP 文档(2025))。

决策指南:何时使用哪种方案?

✅ 使用 Claude Skills 当:

- 你在 Claude 中重复执行结构化工作流(如文档/报告套件、风格合规检查、表格/幻灯片生成)。

- 你希望最小化设置成本,同时高效利用上下文 token,并支持部分离线操作。

- 你的团队更倾向于维护模板/检查清单,而非搭建基础设施。

✅ 使用 MCP 当:

- 你需要访问实时企业数据,或跨系统执行操作,并要求集中治理。

- 你希望构建一个可被多个主机/智能体复用的统一集成层。

- 你重视凭证隔离、白名单控制和审计追踪。

✅ 使用平台工具/插件当:

- 你需要在特定厂商产品内快速实现单一功能。

- 你正在进行短期实验或早期原型开发。

- 你的组织已全面采用某厂商技术栈,希望走最省力的路径。

部署模式(从个人到企业)

个人/高级用户

从预构建或轻度定制的 Skills 开始,用于内容与分析工作流;选择性启用代码/计算机使用功能。团队/部门

建立经过审核的 Skill 库,制定命名规范与负责人制度。对于需要共享访问的集成(如 CRM、问题跟踪系统),先部署小型本地 MCP 服务器(stdio),稳定后再迁移到带认证的远程服务器。企业/受监管环境

优先使用 MCP 访问系统:在服务器中隔离凭证,强制 RBAC,记录使用日志。如平台支持,考虑网络隔离控制与客户托管加密(如 Google 的 VPC SC 与 CMEK,详见 Vertex AI 文档)。将 Skills 用于任务编排与 Claude 内的用户体验一致性。

常见问题

Claude Skills 和 MCP 是一回事吗?

不是。Skill 是 Claude 侧的任务抽象;MCP 是连接客户端与工具/资源/提示的开放协议。Skill 可调用通过 MCP 或平台原生工具暴露的功能。Skills 能否在无网络环境下工作?

部分可以。若 Skill 仅依赖指令和本地代码/计算机使用,则可减少网络依赖。但涉及外部 API 的 Skill 仍需联网。MCP 比平台工具更快吗?

取决于传输方式与拓扑结构。本地 stdio MCP 服务器速度极快;远程 MCP 服务器与平台工具调用延迟相当。MCP 的核心优势在于可移植性与治理能力。免费版 Claude 是否支持 Skills?

Anthropic 官网确认 Skills 覆盖所有 Claude 端,但未明确说明套餐限制。 launch 日媒体报道强调其面向付费用户;截至 2025 年 10 月,免费版支持情况尚未确认。OpenAI 与 MCP 有何关联?

OpenAI Agents SDK 已支持 MCP,开发者可跨生态复用 MCP 服务器。详见 OpenAI — Agents SDK MCP 文档(2025)。

其他值得考虑的替代方案

如果你正在评估面向研究、文档/幻灯片/报告生成等工作流,不妨同时了解 Skywork AI —— 一个专注于可信研究摘要与结构化输出的多模态生产力平台。

声明:Skywork AI 是我们的产品。

来源与延伸阅读(精选,官方优先)

- Anthropic:Claude Skills 概览(2025 年 10 月);Agent Skills 技术深潜(2025 年 10 月);Create files 功能公告(2024)

- MCP:规范 — 架构(2025-03-26);规范 — 服务器工具(2025-06-18);Anthropic — 引入 MCP(2024)

- OpenAI:函数调用指南;Agents SDK MCP 文档(2025)

- Google:Vertex AI 访问控制(IAM、审计、网络、CMEK);Google DeepMind — Gemini 计算机使用模型(2024)

- 安全/媒体报道:Red Hat — MCP 安全风险与控制(2025);The Register — Anthropic ‘Mad Skills’ 报道(2025-10-16)

总结

- 选 Claude Skills:用于快速、可重复的工作流,设置成本低。

- 选 MCP:用于需要可移植、可治理的集成框架,支持多主机复用。

- 选平台工具/插件:用于在特定厂商生态内快速实现功能或原型验证。

实践中,许多团队会组合使用三者:用 Skills 编排任务,用 MCP 在治理下集成系统,用平台工具处理已嵌入的功能。这种分层方法让你既能快速行动,又不会在可移植性与合规性上陷入困境。